Чому ваш сайт не «летить»? 5 критичних помилок у структурі, які вбивають SEO

Можна купити посилання, написати тексти, оновити мета-теги й навіть прискорити окремі сторінки. Але якщо сам каркас сайту зібраний хаотично, зльоту не буде. Уявіть ракету: двигун потужний, паливо дороге, екіпаж досвідчений — але корпус перекошений, а маршрути всередині системи не стикуються. Саме так працює SEO без правильної архітектури. Структура сайту для SEO — це не “другорядна технічка”, а фундамент, на якому стоїть усе інше.

Коли сайт застрягає в рості, проблема часто не в “недостатній кількості контенту”, а в логіці розділів, внутрішній навігації, швидкості та зайвих сторінках в індексі. Нижче — п’ять помилок, які найчастіше ламають зростання навіть сильних проєктів.

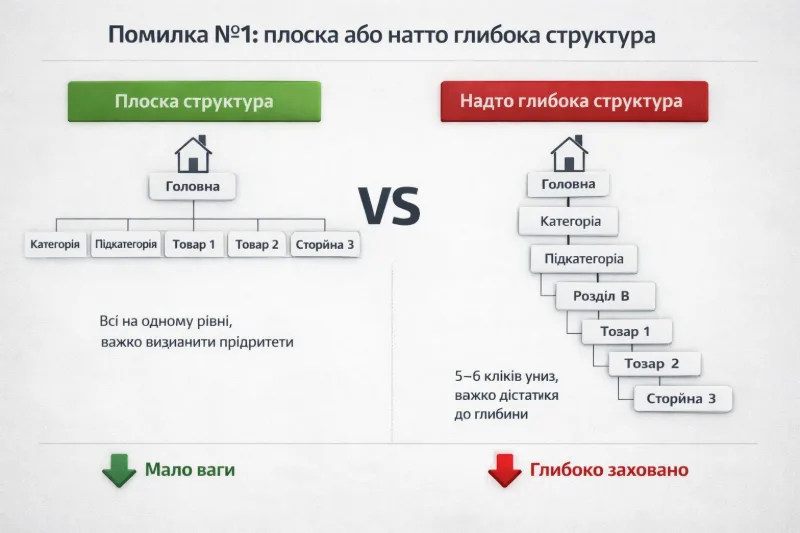

Помилка №1: плоска або надто глибока структура

У поганій архітектурі сайт має або надто плоску, або надто глибоку структуру. У першому випадку всі сторінки лежать майже на одному рівні, і Google важко зрозуміти, які з них головні. У другому — користувач і робот дістаються важливих URL через п’ять, шість, а іноді й сім кліків.

Для SEO це означає одне: сторінки отримують слабший внутрішній сигнал, а ієрархія розділів не працює як система пріоритетів. Особливо боляче це б’є по e-commerce, де архітектура інтернет-магазину повинна чітко вести від головної до категорії, підкатегорії, фільтрованої логіки та картки товару.

Хороший варіант — силос-структура:

- Головна

- Категорія

- Підкатегорія

- Цільова сторінка або товар

Поганий варіант — хаотична структура:

- Головна

- Десятки сторінок без групування

- Дублікати категорій

- Товари й статті, які не підтримують один одного

Помилка №2: хаос у внутрішній перелінковці

Навіть хороша структура не працює, якщо внутрішня перелінковка сторінок зроблена без логіки. Google знаходить і переоцінює сторінки через посилання, тому меню, хлібні крихти, блоки “схожі матеріали”, футер і контекстні лінки мають працювати як навігаційна система, а не як випадковий набір URL. Саме тому варто тримати під рукою рекомендації Google щодо crawlable links.

Найчастіша проблема — слабкий анкорний лист внутрішніх посилань. Наприклад, сторінка про “налаштування Google Search Console” всюди лінкується як “читати тут”, “детальніше” або “перейти”. Для користувача це ще терпимо, а для робота — втрата контексту.

Що варто перевірити:

- чи є в меню прямий шлях до ключових розділів;

- чи підсилює футер важливі сторінки, а не випадкові;

- чи використовують внутрішні анкори зрозумілий зміст;

- чи ведуть статті блогу на комерційні або кластерні сторінки.

Якщо хочете побачити, як Rocketware вже використовує практичну зв’язку SEO та автоматизації, подивіться SEO-ракету про автоматизацію перевірки позицій.

Помилка №3: ігнорування Core Web Vitals

Швидкість завантаження сайту — це не просто гарна цифра у звіті. Це частина реального досвіду користувача. Якщо сторінка довго малюється, стрибає під час завантаження або повільно реагує на дії, вона втрачає і в конверсії, і в SEO-сигналах. У Google Search Console та документації Google зараз Core Web Vitals базуються на LCP, INP і CLS, а не на старому FID. Деталі є в офіційному гайді про Core Web Vitals.

Тут важливо дивитися не лише на PageSpeed Insights результати, а й на причину проблеми:

- повільний LCP часто означає важкий hero-блок, банер або зображення;

- поганий INP сигналізує, що сторінка важко реагує на клік або ввід;

- високий CLS показує, що елементи стрибають і ламають сприйняття.

Для власника бізнесу це виглядає просто: сайт наче красивий, але “гальмує”. Для SEO-фахівця це означає, що структура сторінки й технічна реалізація заважають росту.

Помилка №4: канібалізація запитів

Одна з найпідступніших проблем — коли дві або більше сторінок намагаються ранжуватися за один і той самий намір. Наприклад, є категорія “ноутбуки для роботи” і окрема стаття “кращі ноутбуки для роботи”, але обидві оптимізовані майже під однаковий ключ і мають схожі анкори. У результаті Google не бачить чіткої головної сторінки, а обидві URL послаблюють одна одну.

Канібалізація запитів часто виникає через:

- хаотичне створення нових сторінок;

- дублювання тем у блозі й комерційних розділах;

- відсутність технічного завдання на структуру;

- різні сторінки під один і той самий пошуковий намір.

Лікування тут не косметичне. Потрібно або об’єднувати сторінки, або розводити їх по різних інтентах, або міняти логіку перелінковки й анкорів. Інакше сайт сам собі створює конкурента всередині власного домену.

Помилка №5: «сміттєві» сторінки в індексі

Ще одна причина, чому сайт не летить, — в індекс потрапляє занадто багато технічного сміття. Це можуть бути сторінки фільтрів, службові параметри, внутрішній пошук, пагінація без потреби, дублікати сортувань або технічні URL, які не повинні змагатися в пошуку за краулінговий бюджет.

Критичний момент тут такий: якщо сторінка не повинна ранжуватися, її не треба просто “десь приховати”. Google прямо зазначає, що robots.txt керує доступом до обходу, але не є механізмом для виключення сторінки з індексу. Для цього потрібно використовувати noindex, коли сторінка доступна роботу, але не повинна з’являтися в пошуку. Це добре пояснено в офіційних матеріалах про robots.txt та noindex.

Тому перевірте:

- які фільтри реально корисні для SEO, а які — сміттєві;

- чи не індексуються сторінки сортування;

- чи не плодить пагінація зайві URL;

- чи правильно відокремлені технічні та комерційні сторінки.

Чек-лист «Здоров’я структури»

Перш ніж шукати нові посилання або замовляти ще 20 текстів, перевірте базу:

- чи логічна ієрархія розділів;

- чи проходить ключова сторінка правило 3-х кліків;

- чи працює внутрішня перелінковка сторінок як система;

- чи немає канібалізації між близькими URL;

- чи не душать сайт LCP, INP і CLS;

- чи не засмічений індекс технічними сторінками.

Сайт росте не тоді, коли в нього “багато всього”, а тоді, коли кожна сторінка стоїть на своєму місці й підсилює інші. Саме так мислить досвідчений архітектор: не окремими URL, а цілою системою. Якщо ваш проєкт давно стоїть на місці, почніть не з нового контенту, а з аудиту каркаса. Дуже часто проблема не в тому, що ракета слабка — а в тому, що її зібрали без креслення.

Останні статті

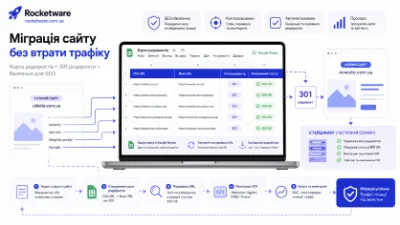

Міграція сайту без просадки: автоматизація карти 301-редиректів

Міграція сайту — це той момент, коли навіть сильний проєкт може втратити роки накопичених SEO-сигналів за кілька днів. Зміна домену, CMS або структури URL виглядає як те…

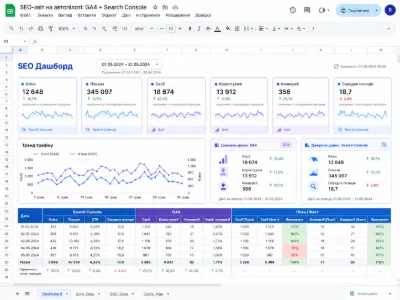

SEO-звіт на автопілоті: єдиний дашборд GA4 + Search Console у Google Sheets

У більшості команд SEO-дані живуть у трьох різних місцях. Search Console показує кліки, покази та середню позицію. GA4 дає сесії, користувачів і конверсії. Окремо ще існ…

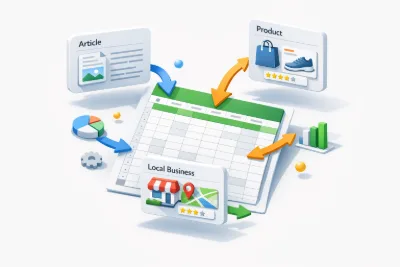

Schema без плагінів: масова генерація розмітки через Google Sheets

Для великого інтернет-магазину мікророзмітка часто стає тим завданням, яке всі розуміють, але постійно відкладають. Причина проста: коли товарів тисячі, ручне додавання…

Google Maps під контролем: як автоматизувати моніторинг відгуків через Google Sheets

Коли у бізнесу 10+ локацій, ручна перевірка відгуків у Google Maps перестає бути рутиною й стає вузьким місцем. Один менеджер не встигає зайти в кожен профіль, другий ві…

Технічний аудит сайту «на стероїдах»: Знаходимо биті посилання за 5 хвилин

Биті посилання — це одна з тих помилок, які довго не кричать про себе, але повільно отруюють SEO. Користувач бачить 404, дратується і йде. Робот бачить зайві переходи, п…

Автоматизація контенту: Як масово генерувати SEO-теги за допомогою ChatGPT API та Google Sheets

Для великого інтернет-магазину одна з найнеприємніших SEO-задач — це мета-теги. Поки каталог росте, сторінок стає вже не десятки, а сотні й тисячі. Частина товарів залиш…